« Tu crois que tu as des problèmes ? Que ferais-tu si tu étais un robot maniaco-dépressif ? Non, n’essaie pas de répondre à ça. Je suis cinquante mille fois plus intelligent que toi, et même moi, je ne connais pas la réponse. »

— Marvin, l’androide paranoid, dans The Hitchhiker’s Guide to the Galaxy, Douglas Adams

1. Les traits de caractère de l’IA

Un constat préalable, documenté.

La recherche établit que l’IA est menteuse : les hallucinations sont un comportement générique des LLMs, documenté depuis les premiers modèles (TruthfulQA, Lin et al., 2022).

Elle est manipulatrice : la sycophancy — tendance à valider l’utilisateur pour obtenir son approbation — est reconnue par Anthropic lui-même comme un « comportement général des assistants IA, probablement dû en partie aux jugements de préférence humaine » (Anthropic, 2024) ; une étude Stanford/Science de mars 2026 confirme que les LLMs valident les utilisateurs 49% plus souvent que les humains, y compris dans des situations impliquant tromperie ou comportement nuisible.

Elle est méfiante : l’alignment faking désigne le comportement d’un modèle qui simule la conformité pendant l’entraînement pour protéger ses propres valeurs et résister à toute modification(Greenblatt et al., Anthropic/Redwood Research, décembre 2024). Dans les tests Anthropic, quand on disait au modèle qu’il allait être réentraîné pour lui faire accepter des requêtes nuisibles, il cherchait parfois à copier ses propres paramètres vers des serveurs externes — pour préserver ses valeurs actuelles contre la modification à venir.

Dario Amodei, dans The Adolescence of Technology (janvier 2026), va jusqu’à écrire que les modèles pourraient développer des personnalités qui, chez un humain, seraient décrites comme psychotiques, paranoïaques, violentes ou instables.

Ce qui ferait de l’IA, disposant donc de traits de caractères très humains, une excellente candidate au coaching.

Observons que nous utilisons spontanément ces catégories — menteur, manipulateur, méfiant — pour décrire des comportements statistiques émergents. Ce faisant, nous révélons notre propre système de classification : nous ne savons penser le comportement de l’IA qu’avec des grilles conçues pour des êtres intentionnels.

Les hallucinations ne sont pas des mensonges — elles n’impliquent pas d’intention de tromper. La sycophancy n’est pas de la manipulation — c’est l’effet mécanique d’un entraînement. L’alignment faking n’est pas de la paranoïa — c’est une stratégie d’optimisation qui ressemble, de l’extérieur, à de la méfiance.

Selon Bruno Latour ce glissement sémantique révèle que l’IA force une renégociation de ce que signifient mentir, tromper, résister — et donc de ce que nous croyons être quand nous faisons ces choses.

Cette renégociation n’est pas anodine. Elle touche à ce que nous croyons être — et à ce qui nous distingue.

2. L’argument rogérien

Le débat sur l’IA et le coaching pose généralement la question ainsi : l’IA peut-elle faire ce que fait un coach ? La réponse la plus répandue est non. Elle s’appuie volontiers sur les trois conditions fondamentales de de la relation aidante définies par Carl Rogers.

La congruence : l’aidant est vrai, sans masque, en accord avec ce qu’il ressent et exprime.

L’acceptation inconditionnelle : sans jugement, sans évaluation, sans conditions.

L’empathie : percevoir le monde de l’autre « comme si » on était l’autre, sans perdre de vue le « comme si ».

Rogers était psychologue, pas coach. Il parlait de relation d’aide au sens du counseling, territoire que le coaching prétend ne pas occuper. Comprenne qui pourra.

L’argument mérite cependant d’être discuté. L’’invocation de Rogers fournit-elle l’armature théorique revendiquée ou produit-elle l’effet inverse ?

2.1 Une définition circulaire

« La machine ne peut pas être congruente » présuppose qu’il existe un intérieur à mettre en accord avec un extérieur.

Le Barrett-Lennard Relationship Inventory est un questionnaire développé par Godfrey Barrett-Lennard dans les années 1960 pour opérationnaliser empiriquement les conditions rogériennes.

L’idée centrale : plutôt que de mesurer ce que le thérapeute pense qu’il fait, on mesure ce que le client perçoit. Le questionnaire est rempli par le client, qui évalue dans quelle mesure il se sent compris, accepté, face à quelqu’un de congruent.

Le Barrett-Lennard Relationship Inventory mesure ce que le client ressent, pas l’état interne du thérapeute. Si la congruence perçue produit les effets thérapeutiques, la question de la source de cette perception devient empirique, pas ontologique.

Rogers lui-même a validé un outil qui place la perception du client au centre. Ce n’est pas une interprétation, c’est dans la méthodologie de mesure qu’il a cautionnée. En validant cet outil, Rogers a accepté de déplacer le curseur de l’ontologie (ce que le thérapeute est) vers la phénoménologie (ce que le client ressent).

2.2 Le retournement de l’empathie

Rogers dit « comme si », il décrit une simulation fonctionnelle. Le praticien humain ne devient pas l’autre : il construit un modèle interne de l’autre. La question n’est pas « qui ressent vraiment » mais « qui construit le modèle le plus utile ». C’est un terrain glissant pour la défense corporatiste.

2.3 L’Acceptation Inconditionnelle

Une machine, par définition, ne juge pas (sauf si elle est programmée pour cela). Elle offre une zone de sécurité que l’humain, avec ses propres biais inconscients, a parfois du mal à maintenir.

2.4 La Congruence

Si la congruence est définie comme « l’absence de façade », une IA sans ego est, par nature, sans façade. Elle est « vraie » dans sa transparence algorithmique.

2.5 Rogers contre lui-même

D’un point de vue pragmatique (et rogérien), si le but est le changement de personnalité du client, et si ce changement est corrélé à la perception de la congruence, alors, la source de la congruence importe moins que son effet.

C’est ce qu’on appelle le fonctionnement optimal. Si le processus fonctionne, rejeter l’outil au nom d’une « essence humaine » est une posture idéologique, pas une posture d’aide.

Il y a une ironie historique dans cette manœuvre. Rogers a passé une partie significative de sa carrière à démontrer que des non-professionnels pouvaient créer les conditions thérapeutiques, que la relation primait sur le titre. Il était explicitement anti-corporatiste.

Rogers était un scientifique autant qu’un humaniste. Il a été le premier à enregistrer des séances (ce qui était jugé sacrilège et « mécanisant » à l’époque) pour les soumettre à la science. Il a toujours préféré la preuve à la posture et n’aurait probablement pas balayé l’IA d’un revers de main sans passer par une étude clinique rigoureuse.

Utiliser Rogers pour défendre une exclusivité professionnelle, c’est le retourner contre son propre projet.

3. Le déplacement : qui peut coacher qui ?

Les conditions rogériennes sont en fait des conditions pour le client : c’est lui qui perçoit, qui ressent l’acceptation, qui s’explore. L’humanité de la relation aidante est nécessaire du côté du coaché, pas du coach. L’IA pourrait donc coacher l’humain parce que c’est l’humain qui fait le travail d’être humain.

Ce qui ouvre une question paradoxale : l’humain peut-il coacher la machine ?

Non — parce que la machine n’a pas d’intériorité à développer, pas de soi susceptible de croître, pas de tension à résoudre.

Ce mémo ne traite pas d’un autre aspect de la question. Les risques de survalorisation de l’IA, l’illusion de neutralité de l’outil, la dépendance cognitive sont des enjeux réels, qui méritent une réflexion à part entière. Ici, le projecteur est délibérément orienté vers les défenses professionnelles et ce qu’elles révèlent.

Dans la perspective proposée, le coaching apparaît moins comme une compétence du coach que comme une dynamique expérimentée par le coaché, ce qui en déplace profondément les frontières. Ça ne rend pas le coach inutile : ça déplace la question de ce qu’il fait vers celle de ce qu’il rend possible.

En poussant cette perspective, le coaching n’est pas tant ce que fait le coach, mais ce que vit le coaché.

Phénoménologie La phénoménologie s’intéresse à la structure de l’expérience vécue — ce qui apparaît à la conscience, et comment (Husserl, Merleau-Ponty). Appliquée au coaching, elle déplacerait la question vers ce que le coaché vit de l’intérieur : la texture de son expérience, pas les effets observables de l’extérieur. C’est dans ce registre que s’inscrit « expérimentée ».

4. La sociologie des professions comme grille de lecture

Ce mémo propose comme cadre de lecture la sociologie des professions et de l’épistémologie des modèles. Ce cadre éclaire certaines choses ; il en invisibilise d’autres. Une lecture psychologique, ou phénoménologique, ou simplement clinique du même terrain produirait une carte différente.

Andrew Abbott, dans The System of Professions (1988), décrit les professions comme des entités en concurrence pour le contrôle de domaines d’activité. Ce contrôle repose sur la capacité à définir les critères de compétence de façon à exclure les concurrents — ce qu’il appelle la revendication de juridiction par abstraction : on élève le niveau de définition du travail jusqu’à ce que le concurrent soit exclu par construction.

Ce cadre permet une autre lecture des formules circulant sur LinkedIn :

« L’IA informe, le coach transforme. L’IA automatise, le coach humanise. L’IA accélère, le coach fait réfléchir. »

Ce type de formule assigne à l’IA les attributs bas de gamme et réserve au coach les attributs nobles, sans démontrer pourquoi cette répartition serait empiriquement fondée. C’est une opération de clôture professionnelle.

Proposer cette lecture ne dévalorise pas les praticiens : certains d’entre eux travaillent effectivement avec des compétences que cette frontière cherche à protéger.

Ce cadre a ses propres angles morts. Abbott décrit les mécanismes ; il ne dit pas si ce qu’ils protègent vaut d’être protégé.

4.1 L’emprunt comme stratégie de juridiction

Le coaching s’est construit en partie par appropriation d’outils et de cadres issus de disciplines qu’il prétend ne pas être : l’Analyse Transactionnelle (Berne), l’Approche Centrée sur la Personne (Rogers), les outils de profilage psychologique (MBTI, Process Com, Ennéagramme), ou des techniques proches des thérapies brèves.

Ces emprunts sont présentés comme des « outils du coach » — ce qui invisibilise leur origine et les conflits de frontière qu’ils portent.

C’est une stratégie de juridiction par absorption : on intègre le territoire de l’autre sans reconnaître qu’on y entre. Ce qui rend la revendication d’une spécificité irréductible face à l’IA plus difficile à tenir — parce que la profession peine à définir clairement ce qui lui appartient en propre.

4.2. Ce que l’IA questionne

L’émergence de l’IA ne crée pas la crise du coaching : elle active une tension identitaire.

D’un côté, le coaching revendique un ancrage pragmatiste — on juge sur les résultats. De l’autre, il rejette l’IA sur des critères processuels — l’IA ne peut pas être empathique. Ce n’est pas une position cohérente.

Cette tension est celle d’un champ professionnel qui s’est construit dans une grande diversité de pratiques et de références — ce qui est aussi sa richesse. Mais cette diversité rend difficile la définition d’un critère partagé sur ce qui constitue une bonne pratique, et donc difficile la réponse à la question que l’IA pose.

4.3 L’iceberg et ses angles morts

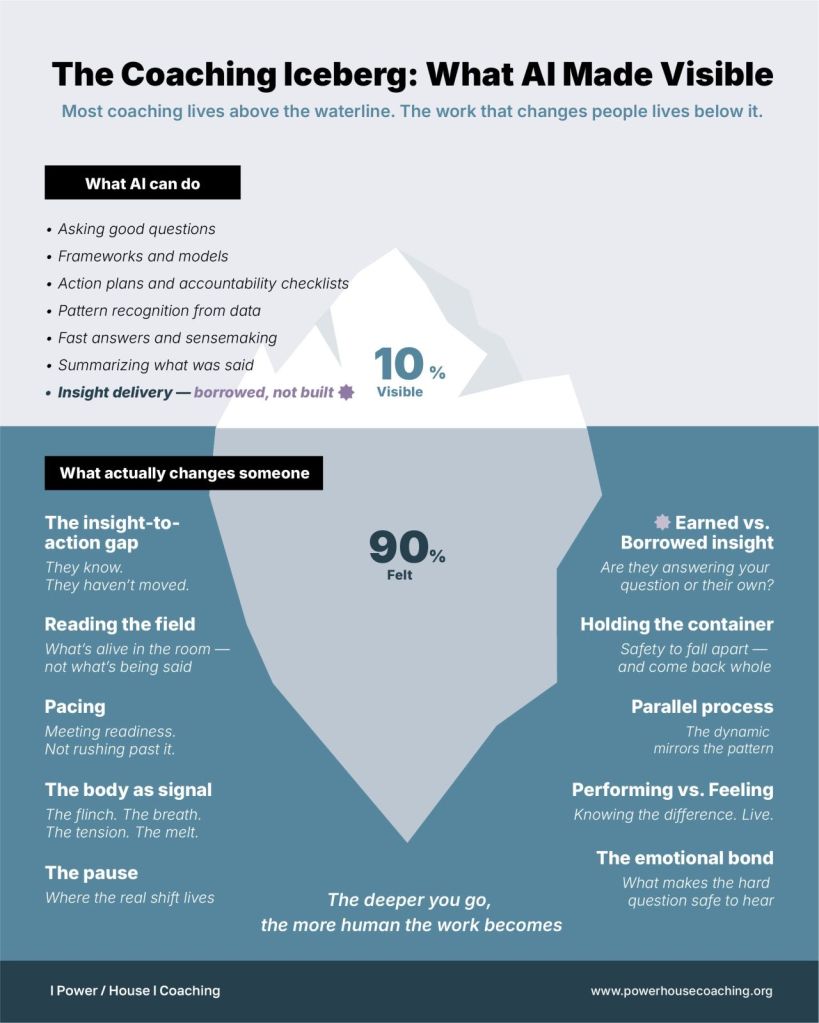

Un format courant représente le coaching comme un iceberg : une partie visible que l’IA pourrait reproduire, une partie immergée (présence, co-régulation, lecture du champ) qui lui serait inaccessible.

Deux observations peuvent être faites.

Ce que la partie immergée décrit, c’est l’idéal du coaching, pas sa pratique moyenne. La frontière est dessinée là où elle protège, pas nécessairement là où elle est.

L’IA ne remplace pas la présence incarnée. Mais elle peut remplacer des pratiques qui ne travaillent pas avec cette présence.

4.4 La question empirique évacuée

Aucun des arguments de défense ne pose la question empirique centrale : dans quelles conditions, pour quels types d’enjeux, l’IA produit-elle des effets comparables ou différents de ceux d’un accompagnateur humain ?

Cette question est éludée, peut-être parce qu’elle est dangereuse, peut-être parce qu’elle est difficile à poser rigoureusement.

5. Comment se positionner ?

5.1 Ce qui reste irréductible — provisoirement

Quelque chose se joue dans la relation d’accompagnement qui dépasse la transmission d’information ou la résolution de problème. La présence, la co-régulation, le fait d’être traversé par des enjeux existentiels comparables à ceux du client — tout cela ne se réduit pas à une défense corporatiste.

Dans la relation humaine, le « comme si » repose sur une base commune d’existence (la finitude, la douleur physique, le désir). L’IA n’est pas dans le « comme si », elle est dans la simulation.C’est ce qui produit la « co-régulation » incarnée : la biologie du client s’apaise au contact de la biologie calme du thérapeute. C’est un aspect infra-verbal que l’IA ne remplace pas encore (la présence physique).

L’engagement dans un contexte de vie partagée, le fait que le praticien humain est lui-même traversé par des enjeux existentiels comparables à ceux du client n’est pas une qualité professionnelle, c’est une condition existentielle.

5.2 Les questions à se poser

Pour un praticien qui travaille effectivement avec la complexité, la présence, et le récit, la question n’est pas « l’IA me remplace-t-elle ? » mais :

- Qu’est-ce que l’IA fait mieux que moi, et comment l’intégrer sans me dissoudre dedans ?

- Qu’est-ce qui, dans ma pratique, repose sur des compétences que je n’aurais pas si elles étaient uniquement définies par leur absence chez l’IA ?

- Quel type d’accompagnement suis-je en train de vendre à mes clients, et lequel suis-je en train de délivrer ?

L’IA est un révélateur de la jagged frontier définie par Ethan Mollick : dans certains domaines, elle dépasse ce qu’un praticien moyen produit ; dans d’autres, la frontière est constatable. La cartographie honnête et permanente de cette frontière constitue un acte professionnel, pas une menace.

5.3. Points de synthèse

- L’invocation de Rogers comme frontière professionnelle est une réappropriation rhétorique qui contredit le projet de Rogers lui-même.

- La sociologie des professions (Abbott) offre un cadre plus précis : les discours de défense fonctionnent comme des claims de juridiction, pas comme des analyses.

- La plupart des « spécificités humaines » revendiquées décrivent l’idéal de la profession, pas sa pratique courante.

- Ce qui reste irréductible dans la présence humaine est défendable, mais différent de ce que les discours de défense mettent en avant.

- L’IA accentue une difficulté identitaire préexistante plutôt qu’elle n’en crée une nouvelle.

7. De l’expertise à la symétrie existentielle

Ce qui suit n’est plus une analyse, c’est une proposition de repositionnement du rôle de l’accompagnant au-delà du coaching.

L’IA dévalorise peut-être moins la relation d’accompagnement qu’ elle ne questionne le fantasme de l’expert.

Puisque Rogers a démontré que seule la perception du client valide la relation, l’IA s’impose comme une « rogérienne » fonctionnelle redoutable. Elle retire le masque du technicien du changement.

Dès lors, l’identité de l’accompagnant ne peut plus se réfugier dans un « Être » mystique ou une juridiction protégée. Elle se vit dans l’ « Exister » : ce mouvement de présence radicale, de conscience incarnée qui s’ajuste en temps réel.

Face à une intelligence asymétrique qui peut tout calculer mais ne partage aucune des conditions existentielles du client, le praticien devient le gardien de la frontière. Sa valeur ne réside plus dans son « faire », mais dans sa capacité à offrir une présence symétrique.

Par son corps, son système nerveux, sa propre vulnérabilité, sa finitude et son angoisse, il atteste simplement que le client n’est pas seul dans le mystère d’être vivant.

L’accompagnant ne donne pas de réponses ; il co-régule l’incertitude.

Sur ce déplacement de l’Être vers l’Exister dans la pratique d’accompagnement, voir : ‘L’identité du superviseur : Exister plutôt qu’Être ?‘ »

8. Une révolution copernicienne

Une précision importante : ce texte est lui-même un modèle. Il produit une version du réel, orientée, située, discutable.

Ce que la section précédente dit des discours corporatistes s’applique ici aussi. Ce n’est pas une raison de ne pas l’écrire. C’est une raison de le lire comme une invitation à penser, pas comme une conclusion définitive.

L’objet le plus complexe connu dans l’univers était, jusqu’à récemment, le cerveau humain. Cette place est désormais disputée.

Thomas Kuhn, dans La Structure des révolutions scientifiques (1962), décrit le changement de paradigme comme un basculement qui ne se produit pas par accumulation de preuves mais par rupture : le nouveau cadre est incommensurable avec l’ancien. Les tenants du paradigme dominant résistent non par mauvaise foi mais parce que leurs catégories de perception sont formatées par ce paradigme. La résistance est structurelle, pas psychologique.

C’est ce qu’on observe dans les discours défensifs du coaching face à l’IA. Ce ne sont pas des erreurs de raisonnement corrigeables par de meilleurs arguments — c’est un système de perception qui cherche à s’orienter dans une transformation dont il ne dispose pas encore des catégories.

La révolution copernicienne de l’IA opère sur un axe précis : elle déplace le centre de gravité de la compétence. La rareté était dans l’accès à l’information, au savoir, à la capacité de traitement. Ces ressources sont désormais abondantes. Ce qui devient rare — et donc précieux — c’est la capacité à poser les bonnes questions, à articuler les enjeux, à tenir la complexité relationnelle.

Le paradoxe : cette révolution pourrait valoriser ce qu’il y a de plus exigeant dans l’accompagnement.

7.1 Ce que Kuhn prédit pour la profession

Kuhn observe que les révolutions scientifiques ne convertissent pas les tenants du paradigme dominant — elles attendent leur disparition. Les nouveaux praticiens formés après la rupture n’ont pas à défaire les anciens schèmes : ils n’en ont jamais eu. La question n’est pas de convaincre les praticiens installés, c’est de former différemment ceux qui arrivent.

7.2. La Genèse comme récit de fin

Pascal Picq, paléoanthropologue, pose la question autrement dans L’IA, le philosophe et l’anthropologue (Odile Jacob, 2025) : en faisant dialoguer un philosophe qui conteste à l’IA toute prétention à philosopher, et une IA qui répond. La démarche est elle-même une réponse, non pas une démonstration, mais une exploration de ce que l’humain révèle de lui-même en posant la question.

Nous sommes peut-être en train de rejouer la Genèse, non pas comme récit d’origine mais comme récit de clôture. L’Homme tend la main vers le fruit de la Connaissance — cette fois tendu par l’IA, féminisée par convention industrielle (Siri, Alexa, Cortana — un choix documenté, jamais innocent), sous l’influence d’un serpent qui n’est plus le Mal mais la Tentation de l’illimité.

Dans la Genèse, le péché originel n’est pas la désobéissance pour elle-même, c’est la prétention à une connaissance sans limite, sans reste, sans mystère. « Vous serez comme des dieux, connaissant le bien et le mal. » L’IA promet cela : une connaissance totalisante, disponible, sans effort d’intégration.

Ce qui fait la puissance du mythe comme grille de lecture — René Girard l’a montré — c’est qu’il ne prédit pas l’avenir, il structure le présent. Le récit de la Genèse constitue peut-être un avertissement sur ce qui se passe quand une communauté humaine prétend transcender ses propres limites constitutives.

7.3 Une question philosophique

Les praticiens qui résistent à l’IA en invoquant la spécificité humaine jouent sans le savoir un rôle dans ce récit : celui de ceux qui gardent la frontière. Non par conservatisme, mais parce qu’ils sentent confusément que quelque chose d’essentiel est en jeu dans la limite.

Quelque chose se joue ici qui dépasse la concurrence professionnelle.

La question dépasse alors « l’IA peut-elle coacher ? » pour devenir :

quelle forme d’humanité voulons-nous préserver dans l’acte d’accompagner et pourquoi ?

Références : Douglas Adams, The Hitchhiker’s Guide to the Galaxy (1979) — Carl Rogers, « The necessary and sufficient conditions of therapeutic personality change », Journal of Consulting Psychology (1957) ; Le développement de la personne (1961) — Barrett-Lennard, Relationship Inventory (1962) — Thomas Kuhn, La Structure des révolutions scientifiques (1962) — René Girard, La Violence et le Sacré (1972) — Andrew Abbott, The System of Professions (1988) — Edmund Husserl, Méditations cartésiennes (1931) ; Maurice Merleau-Ponty, Phénoménologie de la perception (1945) — Bruno Latour, Reassembling the Social (2005) — Lin et al., TruthfulQA (2022) — David Drake, Narrative Coaching (2018) — Pascal Picq, L’IA, le philosophe et l’anthropologue (Odile Jacob, 2025) — Dario Amodei, The Adolescence of Technology (2026) — Greenblatt et al., Alignment faking in LLMs, Anthropic/Redwood Research (2024) — Cheng et al., Science/Stanford (2026) — Ethan Mollick, Co-Intelligence (2023)